Видеоконференция Право-мед.ру № 327 (14) от 5 мая 2026 года, на которой обсуждалась информации о возможном применении врачами учреждения здравоохранения генеративного ИИ в Нижегородской области

А. Панов:

Четырнадцатая видеоконференция текущего года, 327-я с начала работы формата. Мы не можем быть на обочине вопросов генеративного искусственного интеллекта. Поэтому тема обсуждения — как его использовать в медицинской практике.

Информационный повод — публикация в местном СМИ Нижегородской области о том, что врачей поймали на использовании чата GPT при постановке диагноза. А поводом стали жалобы на необычную стилистику текстов.

Тем не менее, Нижегородский Минздрав опроверг эти данные об использовании врачами чата GPT: «Эта информация не соответствует действительности.

СМИ передало информацию в искажённом виде.

В медицинских организациях Нижегородской области постановка диагноза осуществляется в строгом соответствии с клиническими рекомендациями и стандартами лечения». Тем не менее, почему-то медикам было направлено указание о недопустимости использования графических спецсимволов в электронных медицинских картах.

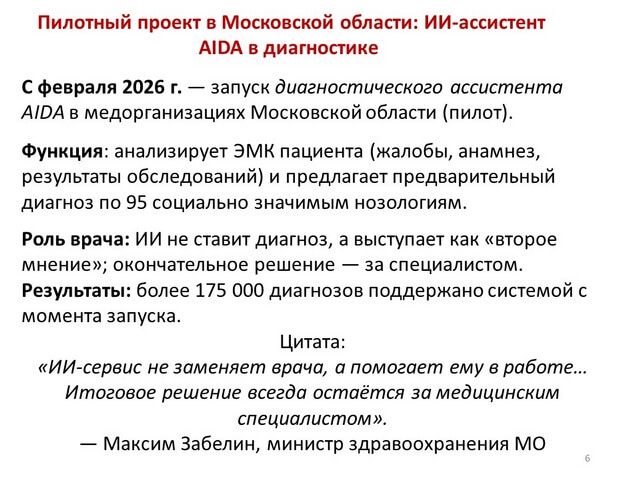

Ещё информация с сайта Минздрава Московской области о том, что более 175 000 диагнозов помог поставить искусственный интеллект в поликлиниках Подмосковья.

Максим Забелин, Министр здравоохранения Московской области, говорит о том, что искусственный интеллект «Аида» анализирует электронные медицинские карты и предлагает предварительный диагноз по 95 социально значимым нозологиям.

Он не ставит диагноз, а выступает как «второе мнение», окончательное решение — за специалистом.

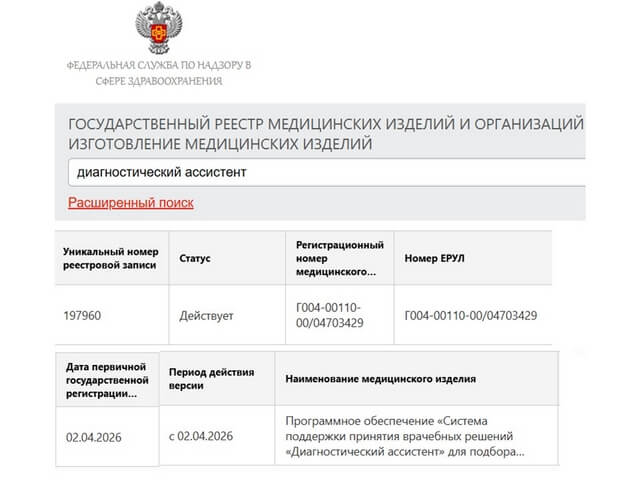

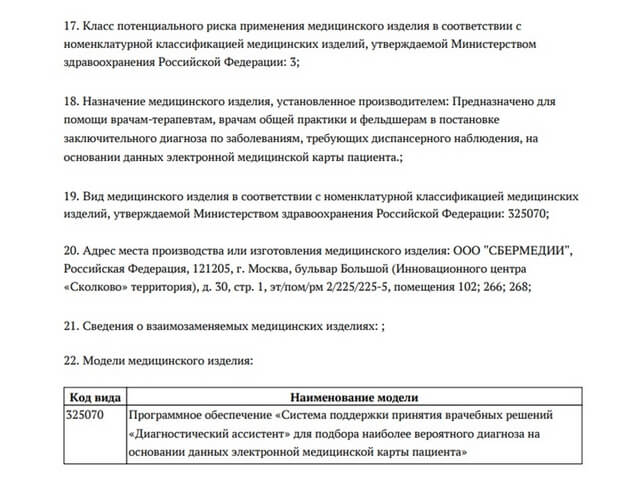

Я обратился к реестру Росздравнадзора по медицинским изделиям.

Где же эта «Аида»? Числится ли она? К сожалению, информации не нашёл. Была выписка из Госреестра Росздравнадзора о том, что имеется программное обеспечение системы поддержки принятия врачебных решений — «Диагностический ассистент» для подбора наиболее вероятного диагноза на основании данных электронной медицинской карты пациента.

«Аиду» я не нашёл, может быть, плохо искал.

Вопрос, который я вынес на обсуждение коллег: создаёт ли использование врачом генеративных нейросетей при постановке диагноза или оформлении документации риски нарушения законодательства, влекущие юридическую ответственность специалиста?

Моя презентация закончена. Дмитрий, слушаем вас.

Д. Гаганов:

Создаёт риски. Причём риски очень специфические. Дело в том, что генеративный ИИ (генеративный искусственный интеллект) настраивается на пользователя. Это вообще называют «дружелюбностью». Однако граница между дружелюбностью и потаканием очень тонкая. ИИ выдаёт ожидаемый ответ тому, кто к нему обратился, учитывая, в том числе, активность вопрошающего в интернете.

При этом отсутствует, я бы назвал это, некий «медицинский фильтр». Дело в том, что при очном приёме врач, даже обладающий базовыми знаниями в клинической психологии, прекрасно понимает, когда у пациента нарушен внутренний образ болезни. Есть особенности личности, тип темперамента: пациент может недооценивать или переоценивать своё состояние, проявлять признаки синдрома Мюнхгаузена — считать, что у него есть определённая болезнь.

Представим: такой «Мюнхгаузен» обратился к чату GPT, создал себе прекрасную картину болезни и с ней пришёл к врачу. Врач тоже обратился к чату GPT — всё подтвердилось, и было назначено лечение. Если убрать этот человеческий фильтр, возникает ситуация, связанная, в том числе, с галлюцинациями искусственного интеллекта.

На эту тему мало исследований, но недавно появилась работа Колотаева и Безлуцкой «Ограничение научного использования больших языковых моделей». Там поднимается вопрос так называемого «обучения» или формулировки промптов (на жаргоне). На каком материале обучали этот генеративный ИИ?

Что касается ответственности: принимая во внимание те слайды, которые выложил Алексей, юридическая ответственность наступает, когда применяется немедицинское изделие, то есть когда не используется медицинское изделие, составной частью которого является искусственный интеллект. Более того, существует правило: ИИ должен находиться в состоянии постоянного мониторинга со стороны специального программного обеспечения Росздравнадзора.

Были проблемы, например, с медицинским изделием, содержащим ИИ, — кажется, оно называлось «Боткин AI» («Боткин — искусственный интеллект»). В таком случае ответственность ложится на врача, поскольку это фактически ненадлежащая диагностика и принятие неправильных решений.

Ради примера скажу (не ради смеха, скорее, со слезами): я столкнулся с такой ситуацией. Не скажу, в какую поликлинику заходил, но потом на «Госуслугах» мне пришла красивая «портянка» на полтора листа, где оказывалось, что меня осмотрели, провели колоноскопию, выполнили антропометрию и ещё массу процедур. Видно было, что это был готовый шаблонный текст.

Что касается ситуации с нижегородскими врачами — там всё ясно. Дело в том, что, например, в Яндексе есть Алиса. Когда ей задают вопрос, она генерирует текст с определёнными графическими значками. Скорее всего, здесь, как говорят молодые, произошёл «копипаст» — скопировали и вставили. Эти значки являются метками стахостических моделей ИИ и указывают, что текст сгенерирован искусственным интеллектом. Они нужны для того, чтобы другие нейросети, сканирующие интернет, понимали происхождение текста.

Кроме галлюцинаций, есть ещё и «самоотравление»: ИИ ссылается сам на себя, затем снова на себя — и так по кругу.

В заключение — скандал в США: человек умер, потому что обращался к ИИ за советами по лечению. Тот посоветовал ему лечиться перекисью водорода. ИИ обучился на псевдонаучных сайтах, где американские «целители» утверждали, что перекись — панацея от всех болезней, её нужно правильно разбавлять водой и постоянно пить. ИИ принял эту информацию, проанализировал симптомы, введённые пользователем, и сформировал план лечения перекисью водорода на несколько недель вперёд — с дозировкой и временем приёма. Пациент следовал рекомендациям — и умер.

Вот кратко то, о чём я хотел сказать по этой теме.

А. Панов:

Благодарю, Дмитрий. Продолжаю.

Согласно Федеральному закону № 323-ФЗ «Об основах охраны здоровья граждан в Российской Федерации», медицинский работник, в том числе врач, оказывает медицинскую помощь на основе своей квалификации, должностных и служебных обязанностей, а также в соответствии с должностной инструкцией.

Таким образом, если в ваших локальных нормативных актах или должностной инструкции ничего не говорится о праве использования чата GPT для получения информации, но вы всё же им пользуетесь — и об этом становится известно, как, например, случилось в Нижегородской области, — то, вероятно, возникают основания для привлечения к дисциплинарной ответственности за использование чата GPT.

С другой стороны, я не случайно привёл пример с «Аидой» в Московской области, где искусственный интеллект официально применяется для предварительной постановки диагноза. На мой взгляд, ключевое отличие Подмосковья от Нижегородской области заключается в том, что в первом случае используется официально зарегистрированный программный комплекс — диагностический ассистент. Я не нашёл его в реестре медицинских изделий Росздравнадзора, но, возможно, просто недостаточно внимательно искал, и он действительно разрешён к применению.

В любом случае, как подчёркивает Максим Забелин, министр здравоохранения Московской области, окончательное решение при постановке диагноза всегда остаётся за врачом. Согласно тому же Федеральному закону № 323-ФЗ, диагноз ставится исключительно на основе совокупности данных клинического обследования пациента, а не на основании рекомендаций чата GPT.

Юридическую ответственность за качество медицинской помощи, включая постановку диагноза, несёт лечащий врач.

Самовольное использование чата GPT, особенно в нарушение должностной инструкции, должно, по моему мнению, выявляться в рамках системы внутреннего контроля качества и безопасности медицинской деятельности — при условии, что эта система функционирует надлежащим образом.

Именно тогда в медицинской документации пациентов не будут появляться странные графические символы или «смайлики», характерные для машинно-сгенерированного текста.

Остановить внедрение искусственного интеллекта в здравоохранение невозможно, но его применение должно быть разумным и находиться под контролем государства. Только так можно избежать трагических случаев, подобных тому, о котором рассказал Дмитрий Гаганов — когда пациент погиб, следуя рекомендациям ИИ лечиться перекисью водорода.

На этом завершаю своё выступление. Благодарю Дмитрия за очное участие в обсуждении этой, безусловно, актуальной темы. Дмитрий, всего доброго.

И. Степанов

Добрый день, уважаемые коллеги.

Прежде всего, хотелось бы отметить, что законодательство, регулирующее применение искусственного интеллекта, находится сейчас в стадии становления и совершенствования. Особое внимание уделяется установлению категории риска его применения.

Медицинская деятельность — в части постановки диагноза и назначения лечения — относится к категории высокого риска использования искусственного интеллекта с точки зрения безопасности. Это связано с потенциальными ограничениями самого ИИ: несовершенством алгоритмов, неопределённостью выбора данных, недостаточным учётом их клинической значимости при анализе.

Поэтому нельзя полагаться в постановке диагноза и назначении лечения исключительно на искусственный интеллект без участия человека — лечащего врача. Врач в любом случае ставит свою подпись под заключением и несёт юридическую ответственность за некачественную медицинскую помощь, тем более — за её последствия.

Следовательно, правомерно устанавливать запрет на использование искусственного интеллекта для постановки диагноза и назначения лечения без участия врача, поскольку ИИ не является субъектом оказания медицинской помощи.

Спасибо.

Участники:

Панов Алексей Валентинович, главный редактор информационного портала Право-мед.ру, г. Омск, член АЮР

Гаганов Дмитрий Борисович, юрисконсульт Ассоциации организаторов здравоохранения в онкологии, г. Санкт-Петербург

Степанов Игорь Олегович, врач - невролог, юрист, председатель Ярославской областной общественной организации инвалидов-больных рассеянным склерозом "Гефест", г. Ярославль, член АЮР

Право-мед.ру

Право-мед.ру