Видеоконференция Право-мед.ру № 323 (10) от 31 марта 2026 года, на которой обсуждался Национальный стандарт РФ ГОСТ Р 72484-2025 "Системы искусственного интеллекта в здравоохранении. Термины и определения. Классификация"

А. Панов:

Десятая видеоконференция текущего года и 323-я с начала работы формата. Рассматривать мы будем автономность цифровых алгоритмов в диагностическом процессе. Сразу можно предположить, что речь пойдёт об искусственном интеллекте.

Напомню: первая видеоконференция у нас состоялась в мае 2016 года — 10 лет назад. Кто бы мог подумать 10 лет назад, что мы будем обсуждать вопросы искусственного интеллекта как субъекта возможных правоотношений, которые требуется регулировать законодательством. Информационный повод: появился новый национальный стандарт ГОСТ 2025 года, принятый в прошлом году, в конце декабря, но опубликованный в текущем году — «Системы искусственного интеллекта в здравоохранении. Термины и определения. Классификация».

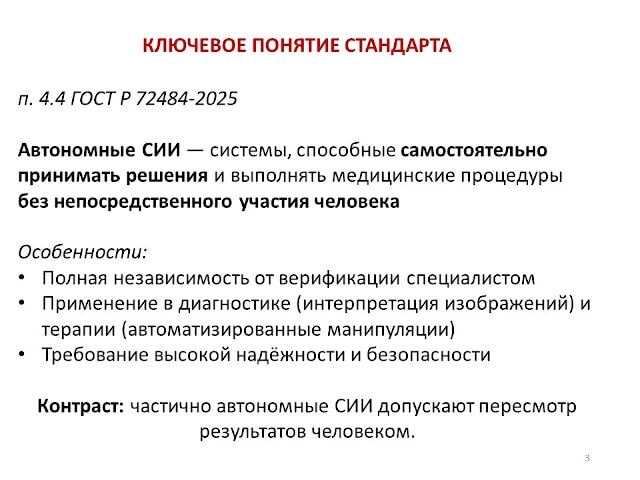

Ключевое понятие стандарта — автономные системы искусственного интеллекта как системы, которые самостоятельно принимают решения и выполняют медицинские процедуры без непосредственного участия человека.

Нюансы: полная независимость от верификации специалиста, применение в диагностике, интерпретации изображений либо в терапии, некие манипуляции. Требования высокой надёжности и безопасности.

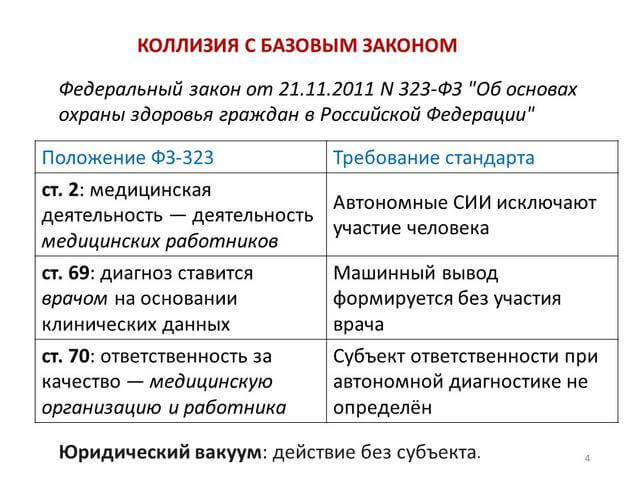

В чём же коллизия стандарта и 323-го Федерального закона? По 323-му закону мы знаем, что медицинская деятельность — это деятельность медицинских работников. В то же время автономная система искусственного интеллекта исключает участие человека. Диагноз по 323-му закону ставится врачом на основании клинических данных, а по стандарту машинный вывод формируется без участия врача. Ответственность за качество и безопасность медицинской деятельности несёт медицинская организация и работник. А при использовании системы искусственного интеллекта субъект ответственности при автономной диагностике и наличии ошибки не определён. То есть имеет место юридический вакуум: есть действия, но нет субъекта отношений.

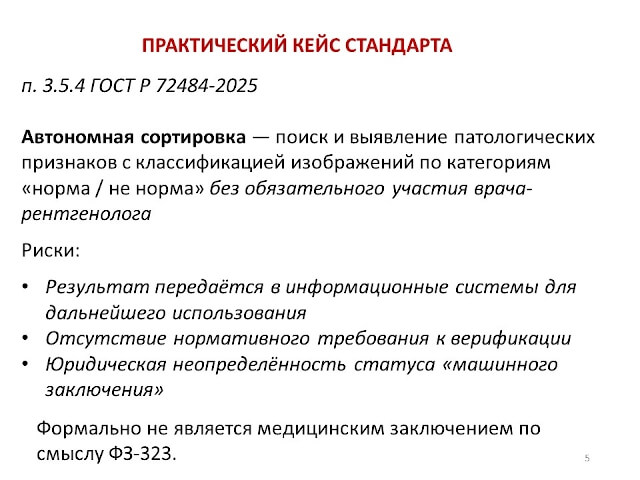

Практические кейсы стандарта: автономная сортировка, когда выявляются патологические признаки с классификацией изображений по признаку «норма — не норма», причём не участвует врач-рентгенолог. Результат передаётся в информационные системы для дальнейшего использования. Нет нормативных требований к верификации, и имеет место юридическая неопределённость статуса машинного заключения. Формально машинное заключение не является медицинским заключением, и возникают проблемы с субъектом права.

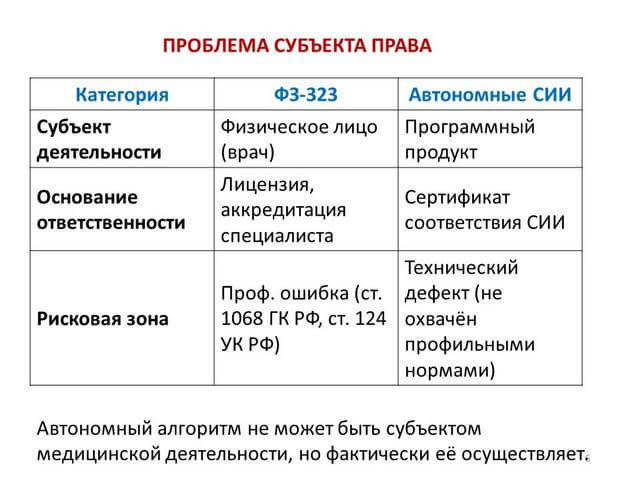

Субъект деятельности — врач; программный продукт — основание ответственности: допуск — это документы по 323-му закону. Автономная система искусственного интеллекта — некий сертификат соответствия системе искусственного интеллекта. Рисковая зона: возможно причинение вреда, ответственность несёт работодатель в рамках технического дефекта. Рисковая зона не охвачена профильными нормами. То есть автономный алгоритм не может быть субъектом медицинской деятельности, но фактически её осуществляет.

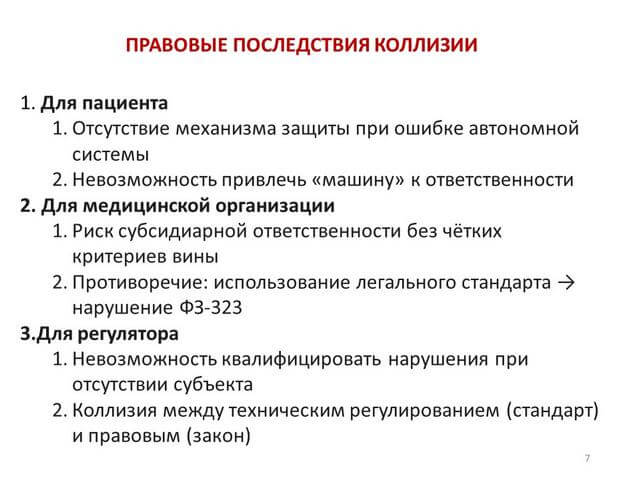

Правовые коллизии: Для пациента — отсутствие механизма защиты при ошибке автономной системы. Привлечь машину к ответственности невозможно. Для медицинской организации — риск субсидиарной ответственности, поскольку используется система искусственного интеллекта, но без чётких критериев вины. Имеет место противоречие: есть легальный стандарт, но нет упоминания в 323-м Федеральном законе. Для регулятора — невозможность классифицировать нарушение при отсутствии субъекта. Коллизия между техническим регулированием (стандарт) и правовым (закон).

Вопрос для обсуждения — это уже моя инициатива: необходимость коррекции федерального законодательства для признания юридической силы машинных заключений без подтверждения врачом. Дмитрий, вступление закончил. Как я уже сказал, 10 лет назад подобная тематика и близко не могла прийти нам в голову. Но всё течёт, всё изменяется. Что будем делать?

Д.Гаганов:

Вообще потрясающе. Во-первых, поздравляю, конечно же, с десятилетием. Я являюсь частью этой команды, и мы силами интеллектуальных ресурсов нашей команды попробуем рассмотреть риски и ситуацию со всех сторон. Во-первых, необходимость коррекции законодательства я не вижу, потому что за этим последует снежный ком: изменение судебной практики, контрольно-надзорной деятельности, и сами обязательные требования тогда должны будут меняться. На сегодняшний день искусственный интеллект является частью медицинского изделия. Хочу напомнить, что существует такое понятие, как мониторинг применения систем, содержащих искусственный интеллект.

Это очень интересная конструкция, которая относится скорее к административному праву. При применении медицинского изделия, содержащего искусственный интеллект, некий объём обязательной информации передаётся в Росздравнадзор. Это называется мониторинг. Если информация передаётся — по сути, это разрешённое использование медицинского изделия с искусственным интеллектом. Если не передаётся либо передано что-то не то, применение этого медицинского изделия должно быть приостановлено. Мы такие случаи рассматривали. Была система, по-моему, «Боткин AI», где определённые параметры оказались ненадлежащими, и действие системы было приостановлено.

Что касается поставленного вопроса: во-первых, сразу производят странное впечатление эти ГОСТы в области искусственного интеллекта, поскольку они никак не соотносятся с терминологией, используемой в Федеральном законе № 323-ФЗ, который является рамочным. Кроме тех коллизий, на которые обратил внимание уважаемый Алексей, есть ещё пункт 34.4: «доверенные технологии» — технологии, отвечающие стандартам безопасности, разработанные с учётом принципов объективности и недискриминации. Если мы посмотрим на принципы (их закрытый список в Федеральном законе № 323-ФЗ), то там совершенно другие принципы. То есть изделия, содержащие искусственный интеллект и применяемые в медицинской деятельности, и ГОСТ совершенно не соответствуют друг другу — терминология разная.

Я проверил: это просто перевод с английского, причём не самый удачный. Относительно качества тоже возникает большой вопрос. Возвращаясь к субъектности: на настоящий момент, конечно же, нужны разъяснения по поводу этой автономности и возникновения псевдосубъекта. Необходимо чётко определить, что всё это должно относиться к категории «медицинское изделие». Во-первых, понятие медицинского изделия должно быть родовым по отношению ко всем системам искусственного интеллекта. Понятие медицинского изделия раскрыто в законе № 323-ФЗ.

Ещё один момент: ГОСТ, который мы обсуждаем, содержит ссылку на другой ГОСТ — ГОСТ о медицинских данных. Искусственный интеллект без медицинских данных не существует. Этот ГОСТ от 2021 года содержит целый список типичных случаев использования искусственного интеллекта в различных медицинских специальностях. Соответственно, должно быть разъяснено, что использование медицинских данных для целей искусственного интеллекта не должно создавать нового субъекта. Обращу внимание ещё на один аспект: здесь присутствует особый институт гражданского права — источник повышенной опасности.

Во-первых, нигде в этом ГОСТе я на это не увидел. Уважаемый Алексей упомянул риски субсидиарной ответственности медицинской организации. Если поразмыслить, у нас есть субъект — юридическое лицо, которое применяет медицинское изделие, содержащее искусственный интеллект. Вроде бы субъектность есть. Но автономность в принятии решения вступает в противоречие с законом № 323-ФЗ.

Во-вторых, хотел бы вернуться к источнику повышенной опасности: галлюцинации искусственного интеллекта, так называемые искажения на входящих данных, медицинских данных. Всё это говорит о том, что рано ещё создавать субъекта. При прочтении ГОСТа и просмотре презентации, которую предоставил уважаемый Алексей, возникает ощущение, что мы видим некоего deus ex machina — «бога из машины». Если в Средневековье говорили «по воле Божьей», в том числе медики и врачи, то здесь возникает некий машинный бог, который что-то решает — такая некая воля. И что? В медицинских картах будут писать: раньше писали «по воле Божьей» умер, а сейчас — «по воле машинного интеллекта». Я, конечно, немного утрирую, но есть такое своеобразное техническое поклонение искусственному интеллекту. И, к сожалению, эти поклонники начинают определять политику, в том числе и в сфере здравоохранения. Вот что я хотел бы подчеркнуть и на какие опасности обратить внимание.

А. Панов:

Спасибо, Дмитрий. Хорошее подчёркивание. Мои суждения по всему этому — я с Дмитрием буду солидарен. Такое ощущение, что правотворцы этого национального стандарта возникли как джинны из бутылки, чёрт из табакерки. То есть использовали свои дефиниции, привнесли их под правовое регулирование и обозначили: «Вот оно — автономная система искусственного интеллекта», которая самостоятельно обрабатывает, выдаёт информацию, и используйте эту информацию без допуска медицинского работника. Подобного подхода в 323-м Федеральном законе пока не просматривается. Да, есть медицинские изделия с использованием искусственного интеллекта, но не более того.

Мне представляется, что иерархия здесь должна быть та, на которую обратил внимание Дмитрий: сначала вносим изменения в 323-й Федеральный закон, а уж исходя из этой концепции, мне представляется, нужно будет разрабатывать национальный стандарт в области искусственного интеллекта в сфере здравоохранения. Я считаю невозможным идти от некого подзаконного нормативного акта — как сказал Дмитрий, использованного на основании англоязычных терминов и не самого удачного перевода — для того, чтобы вносить какие-то изменения в 323-й Федеральный закон.

Пока что, на мой взгляд, это сырые положения. Но в чём я не сомневаюсь — рано или поздно в 323-м Федеральном законе появятся какие-то дефиниции, связанные с искусственным интеллектом. В том числе, может быть, с информированием пациента о применении автономных систем искусственного интеллекта. Есть общественные отношения — они пока не отрегулированы. И вот этот национальный стандарт — ну, некий суррогат регулятора этих общественных отношений. Это первая ласточка, первый пробный шар. Эти правоотношения в любом случае будут развиваться и находить законодательное закрепление в 323-м Федеральном законе. Иного просто не дано.

И. Степанов:

Добрый день, уважаемые коллеги. Проблема использования искусственного интеллекта в последнее время стала по-настоящему актуальной. Прогнозируется дальнейшее его развитие вплоть до состояния полной самостоятельности и автономности от субъекта программирования и управления. Что мы имеем сейчас в качестве искусственного интеллекта? Прежде всего — продукт, созданный естественным интеллектом, а также инструмент, призванный решать определённые заранее поставленные задачи.

Мы прекрасно понимаем, что искусственный интеллект не может быть привлечён к юридической ответственности. Возникает вопрос: кто несёт ответственность за дефекты искусственного интеллекта? По аналогии с материальным продуктом следует рассмотреть два аспекта. Первый — дефект самого продукта. Разработчики несут ответственность за его качество. Они должны описать сферу применения, условия применения, ограничения применения искусственного интеллекта. В этом случае ответственность за вред при применении в пределах определённых ими параметров несут разработчики.

Второй аспект — дефект применения продукта. Должны быть определены процедуры его использования субъектами, которые его применяют. Естественно, за нарушение процедуры использования ответственность несёт данный субъект. По сути, нельзя просто сказать: «Вот искусственный интеллект, он вам поставит диагноз и назначит лечение, и все претензии к нему». У продукта и инструмента есть хозяева, и они должны нести ответственность за его применение в рамках закона. Спасибо.

Участники:

Панов Алексей Валентинович, главный редактор информационного портала Право-мед.ру, г. Омск, член АЮР

Гаганов Дмитрий Борисович, юрисконсульт Ассоциации организаторов здравоохранения в онкологии г. Санкт-Петербург

Степанов Игорь Олегович, врач - невролог, юрист, председатель Ярославской областной общественной организации инвалидов-больных рассеянным склерозом "Гефест", г. Ярославль, член АЮР

Право-мед.ру

Право-мед.ру